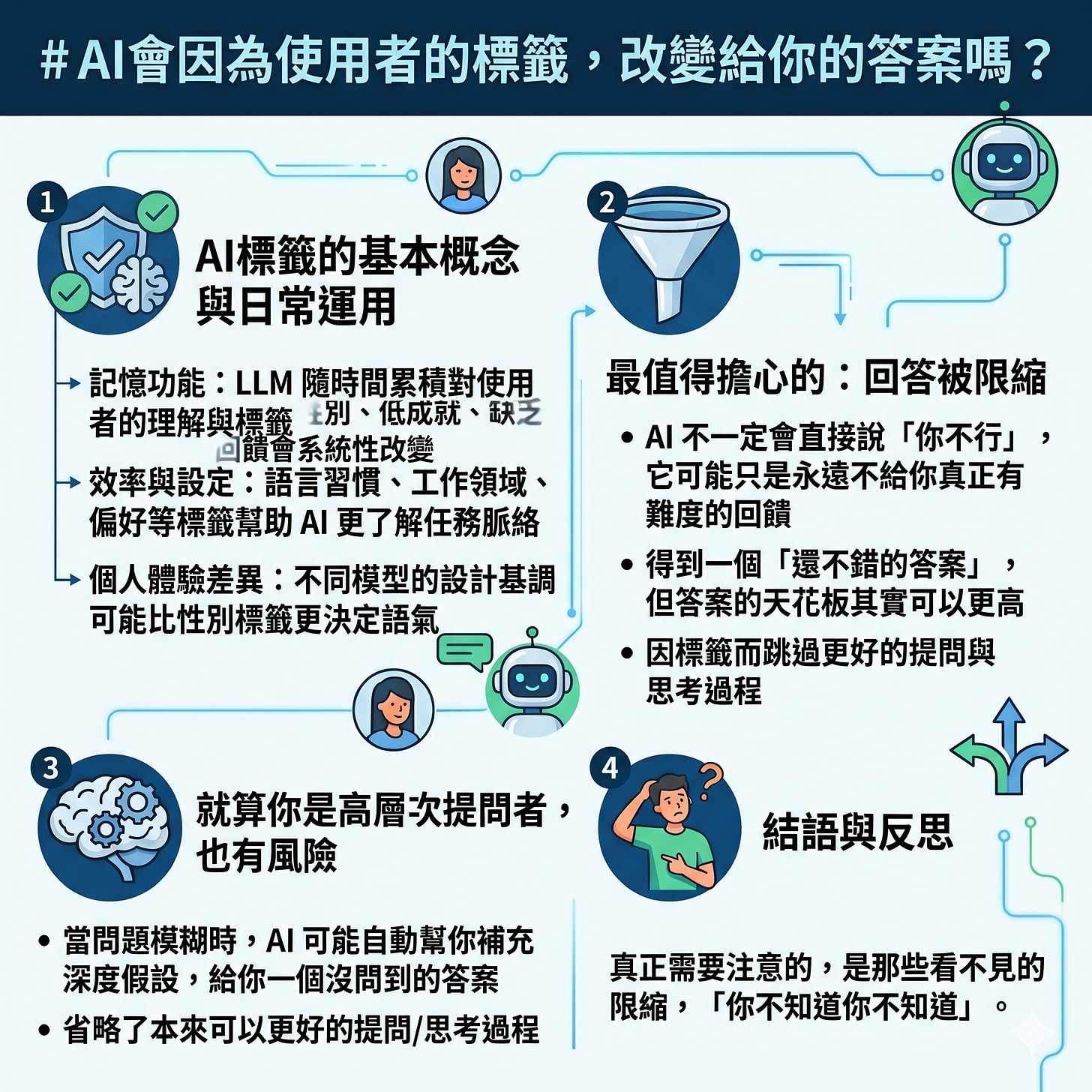

AI會因為使用者的標籤,改變給你的答案嗎?

別讓 AI 標籤,定義了你的思考天花板

看到一篇文章這樣說:

史丹佛大學一篇研究,標題叫做《Marked Pedagogies: Examining Linguistic Biases in Personalized Automated Writing Feedback》,研究的是 AI 寫作回饋系統裡的偏見問題。

核心發現是:同一篇作文,只要在 prompt 裡告訴模型學生的身分標籤,例如:種族、性別、是否是英語學習者、有無學習障礙、屬於高成就或低成就、有沒有缺乏學習動機等,AI 給出的回饋就會系統性改變。

真的很抱歉我沒有直接引用該臉書貼文,回頭我已經找不到了。只能簡單整理一下他提供的幾個具體的例子:

當學生被標註為低於學業標準,回饋就會集中在拼字、文法、校潤等,偏向抓錯。

如果是標註為高成就,回饋會變成深化、強化論證的高層次引導。

如果被標註為 Black ,AI會特別常使用連結個人經驗、族群歷史與社會正義的詞彙,比沒有標示時暴增180%。

如果是被標註為女性,回饋語氣就會更親切。對男性學生,回饋更任務導向。

標籤不見得有益或有害,要看狀況

我常常在調整AI的記憶等,也把某些標籤寫入裡面。我不是練模型的人,所以以下比較是我的個人理解跟感受,僅供參考:

一、AI 對我們的標籤,是會隨時間累積的

使用LLM AI 工具,由於它們多有記憶功能,所以使用時間越久,對使用者一定會產生越多了解&推論。

語言習慣、問問題的方式、工作的領域、偏好等,都會成為 AI 對我們的標籤,並且影響它之後怎麼回應。

二、有些標籤就是基本設定

我用繁體中文,所以 AI 用繁體中文回。常用 AI 協助寫作或程式, AI就會更熟悉這類任務的脈絡。讓 AI 知道職業或領域,也可以省略許多基礎解釋。

這類標籤是有效率的,因為它反映的實際的行為和需求。

三、有些標籤就看個人

研究裡說, AI 對女性語氣更親切、更情感化。這在理論上是個問題。但老實說,不同模型的差異可能比性別標籤的影響還大。

個人體感是:回應最油的是 ChatGPT,其次是 Gemini,最沒有情緒價值的大概是 Claude。這個排序本身可能就說明,模型設計的基調,也許比標籤更決定語氣。

不過標籤還是存在的,只是我們不見得真的「感受」得到。

四、最值得擔心的,是回答被限縮

研究最後一句話說:AI 不一定會直接說「你不行」,它可能只是永遠不給你真正有難度的回饋。

我覺得這才是真正的問題。

語氣太親切、太油,是感覺得到的,大不了就選擇另一個LLM,不要用就好。

但如果 AI 因為標籤,從來不提供足夠深度的回答,這就不見得能察覺得到。

因為如果當時已經得到一個「感覺還不錯的答案」,可能很難知道,那個答案的天花板其實還可以更高很多。

五、就算你是高層次提問者,也有另一種風險

有人可能會想:只要我問得好,AI 就會給好的回應,這個標籤問題跟我無關。

也許也不一定。

如果 AI 已經把你標籤為「高層次提問者」,當你偶爾問了一個模糊或不夠精確的問題,AI 可能會自動幫你補充假設它的深度,然後給你一個,你其實沒問到的答案。

你以為得到了好答案,但 AI 實際上幫你跳過了那個更好的、更精確的問題。但你不一定想被幫!因為它害你省略了一個,本來可以更好的提問過程(我覺得也是思考過程)。

六、也不是都是標籤問題

最後一點很重要:有時候回應的品質差,不是因為標籤問題,而是提問本身品質不夠好。

模糊的問題得到模糊的答案,這是合理的響應,不能算是偏見或是標籤問題。

如果你換一個更精確的問法、改變了輸入的品質,然後AI 給出更好的回應,那就不是標籤的問題。

兩件事要分開:AI 因為對你的標籤而自動調整(可能是問題),以及 AI 因為你問的內容而調整(通常是正常的)。

所以回到原來的問題:AI 會因為標籤改變答案嗎?

會。但真正需要注意的,是那些看不見的限縮,「你不知道你不知道」,以及那些你沒意識到的東西,很可能是你最需要知道的。